随着人工智能、物联网与汽车工业的深度融合,车载辅助产品正从单一的机械或电子装置,演变为由复杂计算机软硬件及辅助设备协同驱动的智能系统。这些产品不仅提升了驾驶的安全性与便捷性,更在重新定义人车交互的方式,构建全新的智能座舱生态。

一、核心硬件:智能汽车的“感官”与“四肢”

车载辅助产品的硬件基础是其感知与执行层,构成了系统的“感官”和“四肢”。

- 环境感知硬件:这是系统的“眼睛”和“耳朵”。主要包括:

- 高清摄像头:用于车道线识别、交通标志识别、前方车辆与行人监测。

- 毫米波雷达:具备强抗干扰能力,负责中远距离的物体探测与测速,是自适应巡航(ACC)和自动紧急刹车(AEB)的核心。

- 超声波雷达:俗称“倒车雷达”,主要用于短距离、低速场景下的泊车辅助与障碍物探测。

- 激光雷达(LiDAR):通过发射激光束构建高精度三维点云图,为高级别自动驾驶提供极其精确的环境模型,是感知硬件的“皇冠”。

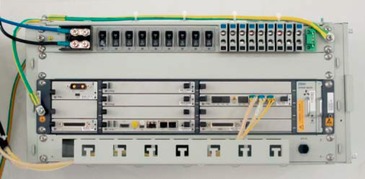

- 中央计算与控制硬件:这是系统的“大脑”和“神经中枢”。其核心是性能日益强大的车载计算平台(域控制器或中央计算单元),它集成了高性能SoC(系统级芯片)、GPU(图形处理器)和AI加速芯片(如NPU),用于实时处理海量传感器数据、运行复杂的算法模型。

- 执行与交互硬件:这是系统的“四肢”和“界面”。包括电子助力转向系统、电子制动系统、电子油门、HUD(抬头显示器)、智能中控大屏、语音麦克风阵列、触觉反馈方向盘等,负责将计算指令转化为车辆的实际动作,并为驾驶员提供直观的信息反馈。

二、核心软件与算法:智能汽车的“思维”与“灵魂”

如果说硬件是躯体,那么软件与算法则是赋予其生命的灵魂。它们运行在硬件之上,负责数据处理、决策规划和交互逻辑。

- 感知与融合算法:这是最底层的软件能力。计算机视觉算法(如CNN卷积神经网络)解析摄像头图像;信号处理算法解析雷达回波。传感器融合算法则像一位“信息协调官”,将不同传感器的数据进行时空对齐与互补,生成一个稳定、可靠、全面的环境感知结果,远超任何单一传感器的能力。

- 决策与规划算法:基于融合后的环境模型,系统需要做出“如何行动”的决策。这包括路径规划(选择从A到B的最佳路线)、行为决策(跟车、超车、变道、停车)和运动规划(生成平滑、舒适、安全的车辆控制轨迹)。这些算法大量运用了机器学习、深度学习以及传统的控制理论。

- 操作系统与中间件:如同PC上的Windows或手机上的Android,车载操作系统(如QNX、Linux、AGL以及各家车企自研系统) 是管理所有硬件资源、调度任务、为上层应用提供稳定运行环境的基础软件。中间件(如ROS2、AUTOSAR Adaptive)则定义了软件模块间的标准通信协议,使得不同供应商的软硬件能够高效、可靠地协同工作,是实现“软硬件解耦”的关键。

- 人机交互(HMI)软件:这直接决定了用户体验。包括智能语音助手(实现自然语言对话控制)、图形用户界面(GUI)、AR导航(将虚拟指引信息叠加在真实道路画面上)、以及基于驾驶员状态监测(DMS)的个性化服务推送等。

三、关键辅助设备:生态的延伸与体验的完善

除了核心的软硬件,一系列辅助设备共同丰富了车载智能生态。

- 高精度地图与定位设备:提供车道级甚至厘米级的先验道路信息(如曲率、坡度、交通标志位置),与实时感知相互校验,为自动驾驶提供“超视距”感知能力。这离不开GNSS(全球导航卫星系统)、IMU(惯性测量单元)和轮速计等定位设备的支持。

- 车联网(V2X)设备:通过C-V2X(蜂窝车联网)或DSRC(专用短程通信)技术,实现车与车(V2V)、车与路(V2I)、车与人(V2P)、车与云(V2C)的实时信息交换。例如,前车紧急刹车信息可瞬间告知后车,实现超视距的碰撞预警。

- 数据记录与仿真设备:用于研发测试的“幕后英雄”。数据记录仪(Data Logger)在路测时记录所有传感器原始数据,用于算法迭代训练。仿真平台则可以在虚拟的“数字孪生”世界中,进行海量、极端、危险的场景测试,极大加速开发进程并保障安全。

软硬协同,共创未来

现代车载辅助产品,本质上是一个移动的、高度复杂的嵌入式计算机系统。其发展遵循着“硬件提供算力与感知,软件定义功能与体验”的核心逻辑。从基础的倒车影像,到L2+级的高级驾驶辅助系统(ADAS),再到展望中的全自动驾驶,每一次功能飞跃都依赖于计算机硬件算力的突破、传感器精度的提升、以及软件算法(尤其是AI算法)的革新。随着芯片制程进步、传感器成本下降、AI模型效率提升,更强大、更普惠的智能驾驶体验,必将在软硬件深度协同的驱动下,驶入千家万户。